直到目前,所有配备了相关辅助性驾驶功能的汽车,驾驶者在使用相关功能时,双手都不允许离开方向盘。“自动驾驶”“辅助驾驶”相关概念,事实上涉及严肃的责任划分,但过去多年,因为宣传上的混淆,这些概念的边界对普通消费者来说仍然不那么清楚。

8月14日,国内餐饮连锁品牌“美一好”发布讣告称:其创始人林文钦先生(昵称“萌剑客”)因驾驶蔚来ES8汽车并在启用自动驾驶功能(NOP 领航状态)后发生交通事故,不幸逝世,终年31岁。

讣告发布后,有关“自动驾驶”的争议迅速引发了公众讨论。蔚来方面迅速回复媒体称,蔚来汽车的NOP领航辅助不是自动驾驶,后续有调查结果会向外界同步信息。

2018年9月19日,上海,蔚来es8新能源车。

在去年10月8号发布的《领航辅助(NOP)使用指南》中,蔚来解释了NOP,即Navigate On Pilot的概念。根据蔚来的定义,是一个自动辅助导航驾驶系统,融合了车载导航与蔚来自主研发的NIO Pilot自动辅助驾驶功能,允许车辆在特定条件下按照高精地图导航规划的路径自动巡航行驶。蔚来汽车在成功开启NOP后,车辆可以在不需要驾驶员拨动转向拨杆的情况下完成四件事:

自动汇入主路;

在主路中巡航行驶,并智能选择最优车道;

根据导航规划自动切换至下一条高速/高架;

自动驶离主路。

也就是说,相比于蔚来此前的NIO Pilot自动辅助驾驶功能习惯保持在当前车道内行驶的特点,NOP最大的差异就是蔚来官方解释的那样,实现了在需要的时刻主动尝试变换车道或是驶入/驶出匝道。

在去年的这份指南开头,蔚来用加粗字体标出了一句话——大家绝对不能把NOP等同于自动驾驶。指南同时强调,NOP仍然是一种辅助驾驶功能,且随时可能在无法满足工作条件的情况下退出。因此,他们也在这份指南中表示,请大家务必在车辆发出变道提示及车辆变道过程中,目视检查和确认变道侧环境安全,必要时随时接管车辆。

然而,从已公布的事故照片的车辆受损程度判断,车辆发生追尾时的车速应该不慢,林先生恐怕没能有足够的反应时间来接管车辆。照片显示,这辆蔚来ES8的右前方严重受损,右前翼子板直接撞进驾驶舱,车辆发动机盖大面积被掀起,已经看不出车辆A柱,顶棚也陷入车内,驾驶员位车门变形严重,两前轮受损。

网络上则流传着一份疑似事故车主林先生的蔚来App中关于旅程的内容。这份内容显示,在车辆最后一次行程为85公里的行驶中,车主使用NIO Pilot的里程为72公里。网传行程记录的最后,车辆的行驶速度从约114公里/时瞬间降至0,瞬时能耗为0,也就是说车辆没有任何紧急制动措施。

这份文件的真假,目前尚未证实。事实上,事故后双方的争议焦点就包括行车数据披露问题。截止目前,林文钦家属和蔚来都认同的部分是:发生事故时,林文钦正在使用 NOP 功能。但根据媒体报道,林文钦家属认为,蔚来员工率先到达事故现场,有删改数据的嫌疑。蔚来则在8月16日公开回应 “公司没有任何删改数据的行为”。

模糊的分级

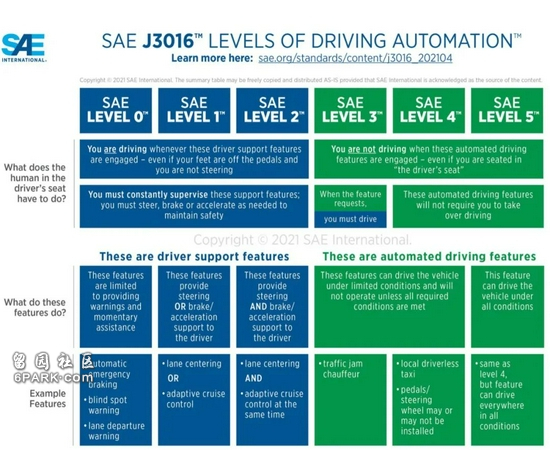

事故发生后,相关厂商的负责人纷纷表态。理想汽车创始人、CEO李想就在微信朋友圈发声,呼吁媒体和行业统一自动驾驶分级的中文名词,认为:L2=辅助驾驶;L3=自动辅助驾驶;L4=自动驾驶;L5=无人驾驶。“一个多余的中文字也不要有。”李想写道。

而威马汽车创始人沈晖则给出了责任划分。在他看来,L2级别辅助驾驶功能,驾驶员是功能操作主体,也是责任主体;L4以上级别自动驾驶功能,车内无人状态下,操作主体是车辆本身,责任主体当归属主机厂。

他们口中的“L”就是自动驾驶技术长期遵循的技术等级划分标准。目前国际上较多使用的是由美国汽车工程师学会(Society of Automotive Engineers)推出的标准,其主要内容为:

0级:无自动驾驶,由人类驾驶员全权操控汽车,可以得到警告或干预系统的辅助;

1级:驾驶支援,通过驾驶环境对方向盘和加减速中的一项操作提供驾驶支持,其他的驾驶动作都由人类驾驶员进行操作;

2级:部分自动化,通过驾驶环境对方向盘和加减速中的多项操作提供驾驶支持,其他的驾驶动作都由人类驾驶员进行操作。

3级:有条件自动化,由自动驾驶系统完成所有的驾驶操作。根据系统要求,人类驾驶者需要在适当的时候提供应答。

4级:高度自动化,由自动驾驶系统完成所有的驾驶操作。根据系统要求,人类驾驶者不一定需要对所有的系统请求做出应答,限定道路和环境条件等。

5级:完全自动化,在所有人类驾驶者可以应付的道路和环境条件下,均可以由自动驾驶系统自主完成所有的驾驶操作。

如果严格按照这个标准,目前国内市场上所有量产的“自动驾驶汽车”都还是L2级别。这些车里携带的系统都只是“辅助”,和“自动”还有很远的距离。然而因为各种各样的原因,我们时常能在市场上到打擦边球的宣传,比如有些车企会宣称在某些特定场景下可以实现L3级别的自动驾驶,但人员稀少的工业园区和北京三环可是两个概念;有的文章中甚至还出现了“L2.5”的说法。

美国汽车工程师学会(Society of Automotive Engineers)推出标准

但事实上,这些打擦边球的字词,关系到严肃的责任划分。2017 年 5 月 12 日,德国联邦参议院通过法律,允许自动驾驶车辆在特定条件下代替人类驾驶。法律明确规定,配有自动驾驶系统的汽车内将安装类似“黑匣子”的装置,记录系统运作、要求介入和人工驾驶等不同阶段的具体情况,以明确交通事故责任。如果事故发生在人工驾驶阶段,则由驾驶人承担责任;如果发生在系统运作阶段,或由于系统失灵酿成事故,则由汽车制造商承担责任。

国内稍微滞后一些,公安部今年4月才发布《道路交通安全法(修订建议稿)》,向社会公开征求意见。修订建议稿规定,具有自动驾驶功能且具备人工直接操作模式的汽车开展道路测试或者上道路通行时,应当实时记录行驶数据;驾驶人应当处于车辆驾驶座位上,监控车辆运行状态及周围环境,随时准备接管车辆。发生道路交通安全违法行为或者交通事故的,应当依法确定驾驶人、自动驾驶系统开发单位的责任,并依照有关法律、法规确定损害赔偿责任。构成犯罪的,依法追究刑事责任。

对于这一规定,中国联通网络技术研究院车联网高级总监刘琪认为:表述仍过于原则化,在实际操作中,针对哪一级别的自动驾驶等级,各方主体要承担什么责任;什么情况下驾驶员应担责,什么情况下判定是自动驾驶系统的责任等,均没有具体界定。

混淆的“自动”

回到此次蔚来车辆的事故,目前原因仍在调查中,事故的责任归属仍有待公布。

若查阅蔚来ES8的用户手册,倒是能明确看到一大堆“警告”事项,注明和Pilot一样,“NOP目前还无法响应人、动物、交通灯及静态障碍物(如高速收费站、路障、三角警示牌等),如果路线前方存在事故、施工区域、临时封路等情况,请大家立即接管车辆。”

这些“警告”是用生命换来的。2016年1月20日,车主高雅宁驾驶特斯拉Model S行驶在京港澳高速河北邯郸段公路时,因未能及时躲避前方的道路清扫车而发生追尾,不幸身亡。车祸发生半年后的2016年8月16日,特斯拉中文官网将“自动驾驶”一词变为“自动辅助驾驶”,公司要求销售人员严格将这一系统表述为驾驶辅助系统。车载系统升级后也将“Autopilot”的中文翻译从“自动驾驶”改为“自动辅助驾驶”,新系统不再放任驾驶者将双手离开方向盘,当检测不到双手施加在方向盘上的阻力时,会向驾驶者发出警示。

随着国产品牌这些年的成长,各大车企在安全方面的措辞也越来越注意。然而“自动”两个字仍是这些厂商们在宣传时无法割舍的心头好,哪怕他们的产品过了5年后仍然无法识别前方道路上的路障和警示牌。真正的“自动驾驶”本来应该是整个汽车行业追求的终极目标,却在当下这个阶段成为了很多人或有意或无意的宣传重点。

在搜索引擎上输入“自动驾驶”+“解放双手”,你几乎能看到涉及到各大汽车品牌的文章。此时事故后,蔚来副总裁沈斐2019年的一条微博又一次被翻出来,在该条已被删除的微博中,沈斐坐在行驶中的蔚来ES8里,开着NIO Pilot自动辅助驾驶功能,双手却一边吃东西一边拿着手机拍照片。

但事实上,即使到了两年后的今天,所有配备了相关辅助性驾驶功能的汽车,驾驶者在使用相关功能时,双手都不允许离开方向盘。

但经过这几年的概念宣传,很多普通车主在关注“自动”功能时,已经被动或主动地忽略了辅助驾驶的其他关注事项。

好消息是,这种宣传造成的概念上的混乱终于开始得到重视了。因为多起相关事故,近期美国全国高速公路交通安全委员会(National Highway Traffic Safety Administration, 简称NHTSA)对特斯拉公司的Autopilot 自动辅助驾驶系统展开了调查。

初步的调查结果显示,自2018年以来,发生了11起由开启了Autopilot或交通感知巡航系统 (TACC)的特斯拉车辆冲击应急车辆(以及其它事故车辆)的案件,“其中大部分事故发生于夜间,并且现场已经开启了警告措施,包括车辆闪灯、燃烧(电视剧)照明棒、亮灯的告示牌和交通锥等。”某种程度上,特斯拉算得上“自动驾驶”概念混乱的始作俑者。

高盛认为,对于目前市面上流行的L2级的自动驾驶系统,解决方案或许是强化驾驶员监控系统,以确保驾驶员遵守特斯拉的使用条款。但无论具体措施是什么,从监管上加强对相关功能使用场景的限制,并在观念上纠正过去长期以来的“自动”迷思,都势在必行。